- Распределения Эрланга

-

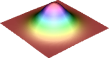

Гамма-распределение Плотность вероятности

Функция распределения

Параметры  - коэффициент масштаба

- коэффициент масштабаНоситель

Плотность вероятности

Функция распределения

Математическое ожидание

Медиана Мода  , когда

, когда

Дисперсия

Коэффициент асимметрии

Коэффициент эксцесса

Информационная энтропия

Производящая функция моментов  , когда t < 1 / θ

, когда t < 1 / θХарактеристическая функция

Га́мма распределе́ние в теории вероятностей — это двухпараметрическое семейство абсолютно непрерывных распределений. Если параметр k принимает целое значение, то такое гамма-распределение также называется распределе́нием Эрла́нга.Содержание

Определение

Пусть распределение случайной величины X задаётся плотностью вероятности, имеющей вид

где функция Γ(k) имеет вид

где функция Γ(k) имеет вид

и обладает следующими свойствами: ;

; ;

;

константы k,θ > 0. Тогда говорят, что случайная величина X имеет гамма-распределение с параметрами k и θ. Пишут

.

.Замечание. Иногда используют другую параметризацию семейства гамма-распределений. Или вводят третий параметр — сдвига.

Моменты

Математическое ожидание и дисперсия случайной величины X, имеющей гамма-распределение, имеют вид

![\mathbb{E}[X] = k\theta](/pictures/wiki/files/51/3d67f549e0bdaf09c695f0f6a775609d.png) ,

,![\mathbb{D}[X] = k\theta^2](/pictures/wiki/files/54/6eb51c26e500757e52da311c2c267763.png) .

.

Свойства гамма-распределения

- Если

— независимые случайные величины, такие что

— независимые случайные величины, такие что  , то

, то

.

.

- Если

, и a > 0 — произвольная константа, то

, и a > 0 — произвольная константа, то

.

.

- Гамма-распределение бесконечно делимо.

Связь с другими распределениями

- Экспоненциальное распределение является частным случаем гамма-распределения:

.

.

- Если

— независимые экспоненциальные случайные величины, такие что

— независимые экспоненциальные случайные величины, такие что  , то

, то

.

.

- Распределение хи-квадрат является частным случаем гамма-распределения:

.

.

- Согласно центральной предельной теореме, при больших k гамма-распределение может быть приближено нормальным распределением:

при

при  .

.

- Если X1,X2 — независимые случайные величины, такие что

, то

, то

.

.

Моделирование гамма-величин

Учитывая свойство масштабирования по параметру θ, указанное выше, достаточно смоделировать гамма-величину для θ = 1. Переход к другим значениям параметра осуществляется простым умножением.

Используя тот факт, что распределение Γ(1,1) совпадает с экспоненциальным распределением, получаем, что если U — случайная величина, равномерно распределённая на интервале (0, 1], то − lnU˜Γ(1,1).

Теперь, используя свойство k-суммирования, обобщим этот результат:

где Ui — независимые случайные величины, равномерно распределённые на интервале (0, 1].

Осталось смоделировать гамма-величину для 0 < k < 1 и ещё раз применить свойство k-суммирования. Это является самой сложной частью.

Ниже приведён алгоритм без доказательства. Он является примером выборки с отклонением.

- Положить m равным 1.

- Сгенерировать V2m − 1 и V2m — независимые случайные величины, равномерно распределённые на интервале (0, 1].

- Если

, где

, где  , перейти к шагу 4, иначе к шагу 5.

, перейти к шагу 4, иначе к шагу 5. - Положить

. Перейти к шагу 6.

. Перейти к шагу 6. - Положить

.

. - Если

, то увеличить m на единицу и вернуться к шагу 2.

, то увеличить m на единицу и вернуться к шагу 2. - Принять ξ = ξm за реализацию Γ(δ,1).

Подытожим:

где [k] является целой частью k, а ξ сгенерирована по алгоритму, приведённому выше при δ = {k} (дробная часть k); Ui and Vl распределены как указано выше и попарно независимы.

Вероятностные распределения Одномерные Многомерные Дискретные: Бернулли | биномиальное | геометрическое | гипергеометрическое | логарифмическое | отрицательное биномиальное | Пуассона | равномерное мультиномиальное Абсолютно непрерывные: Бета | Вейбулла | Гамма | Колмогорова | Коши | Лапласа | логнормальное | Лоренца | нормальное (Гаусса) | равномерное | Парето | Стьюдента | Фишера | хи-квадрат | экспоненциальное | Эрланга многомерное нормальное править

Wikimedia Foundation. 2010.

![\theta \left( \xi - \sum _{i=1} ^{[k]} {\ln U_i} \right) \sim \Gamma (k, \theta),](/pictures/wiki/files/99/c4ed98f33c39f06dc39ba1b97641876f.png)